Хэй! Если вы когда-либо пытались изучать ИИ, вы наверняка хотя бы раз ловили себя на мысли...

"Что здесь вообще происходит?"

20 ключевых концепций ИИ за 20 минут

Слишком много терминов. Слишком много инструментов. И все в интернете говорят так, будто это очевидно.

Изучение ИИ может казаться перегруженным.

Особенно если вы не работаете с ним напрямую - это почти как изучение нового языка.

Но вот что мы поняли...

ИИ на самом деле не такой сложный.

Как только вы понимаете основы - особенно как работают большие языковые модели (LLM) и как устроены современные AI-инструменты - все начинает складываться.

В этой статье мы разберем 20 самых важных концепций ИИ максимально просто.

Без сложного жаргона.

Без лишних усложнений.

Только понятные объяснения и интуитивные примеры - так, как хотелось бы увидеть самому.

Поехали ✌️

Основы

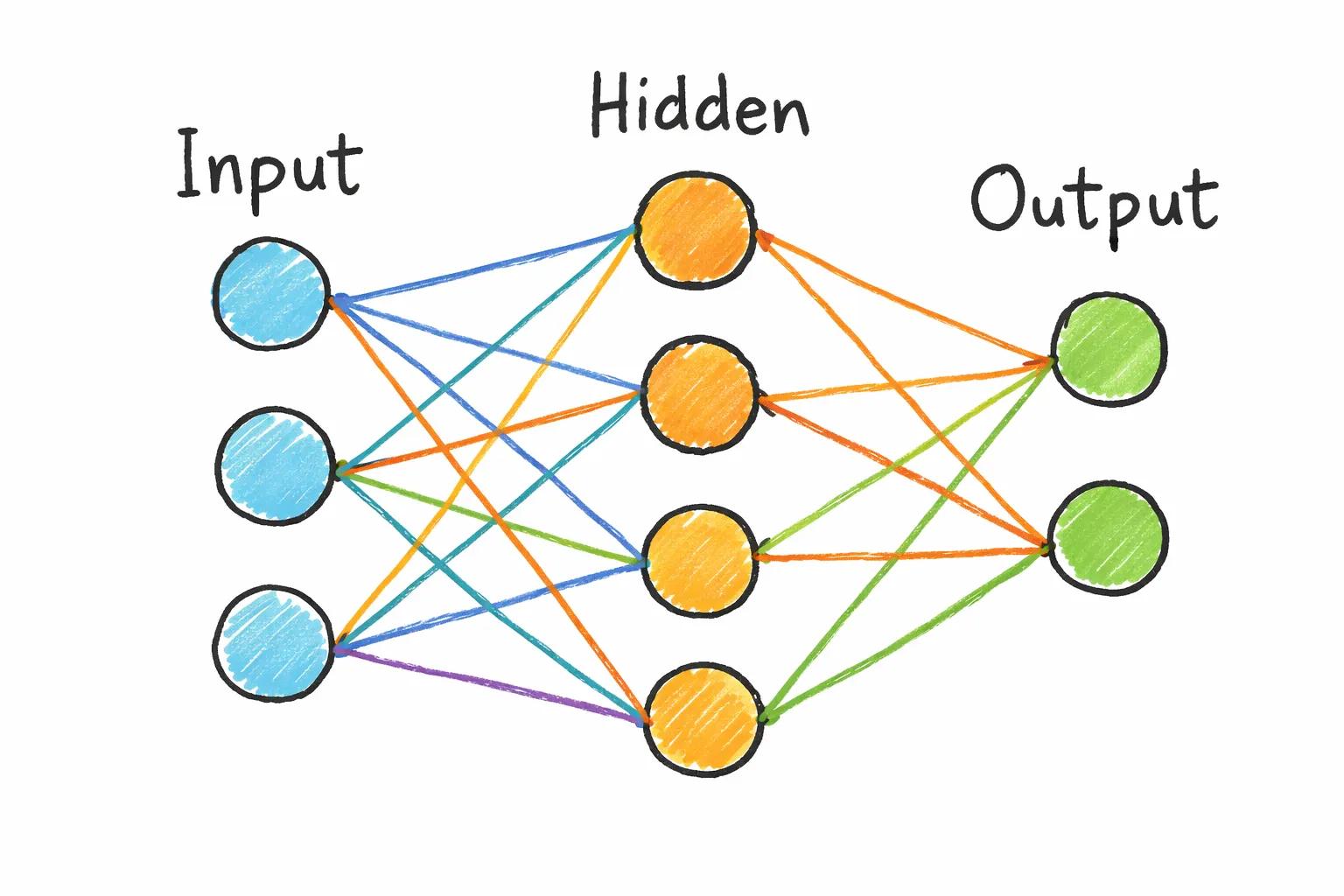

1. Нейронные сети

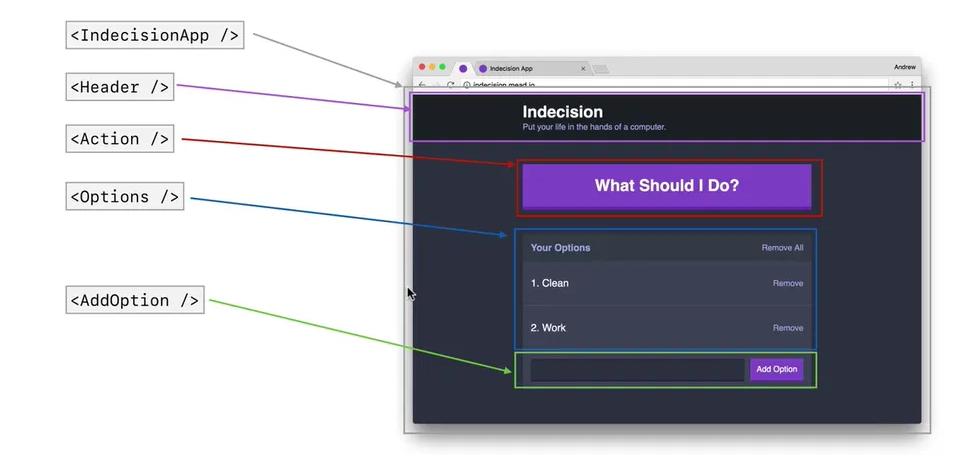

В основе нейронная сеть - это система связанных слоев, состоящих из небольших элементов, называемых нейронами.

Представьте это как конвейер.

Данные поступают во входной слой, проходят через несколько скрытых слоев и в итоге выходят в виде предсказания через выходной слой.

Что происходит внутри?

Проще всего представить это как поэтапное уточнение.

Один и тот же ввод обрабатывается снова и снова,

и с каждым слоем модель понимает его чуть лучше.

Например, в модели для изображений:

- первые слои находят простые признаки - границы и текстуры

- средние - распознают формы и паттерны

- глубокие - определяют реальные объекты

Это переход от пикселей к смыслу.

Теперь важный момент...

Каждое соединение между нейронами имеет вес.

Это как "коэффициент важности", который определяет, насколько один нейрон влияет на другой.

Обучение сети - это постоянная настройка этих весов, пока модель не начнет давать точные результаты.

И вот здесь начинается самое интересное.

Современные модели содержат миллиарды таких параметров.

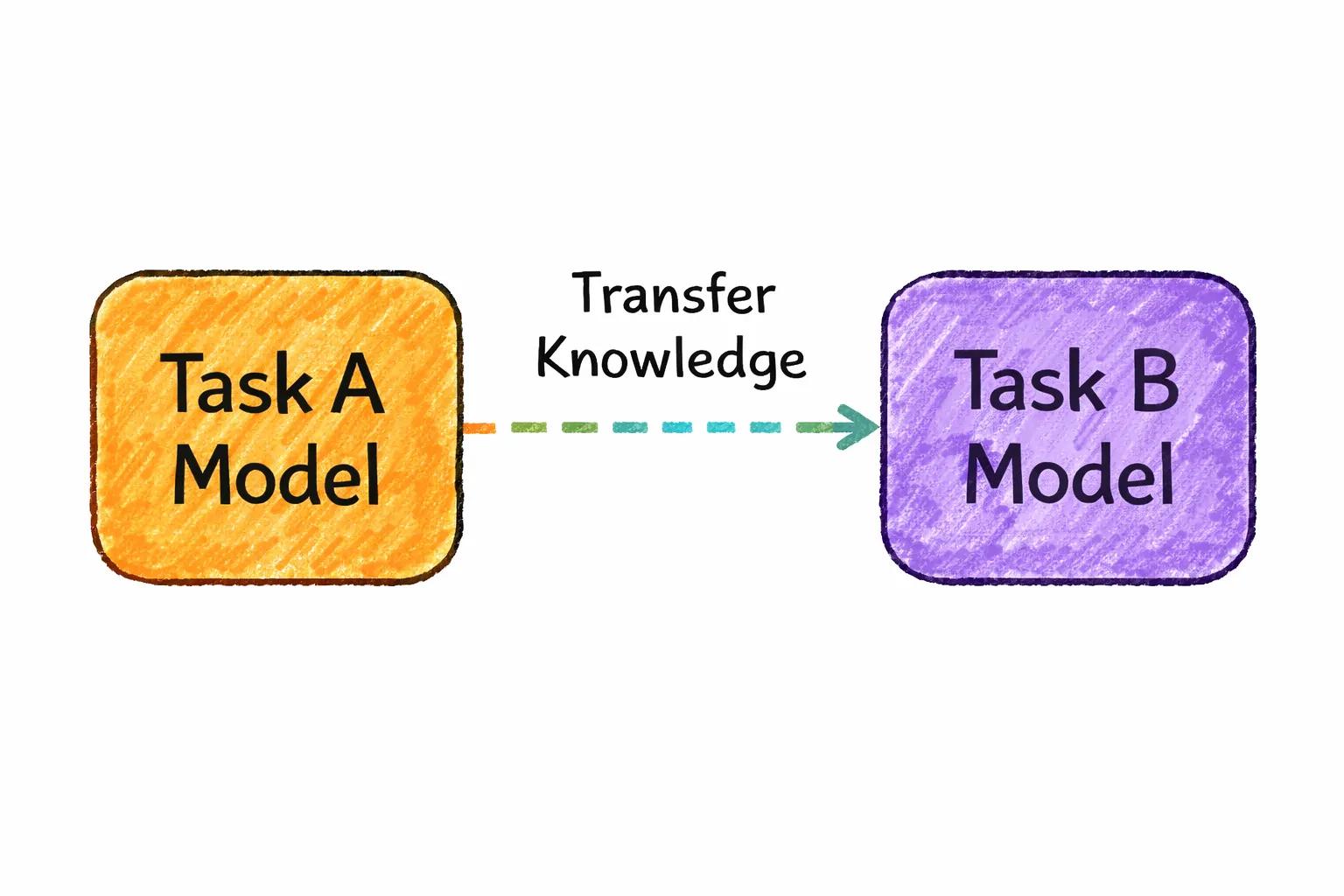

2. Transfer Learning

Обучать модель с нуля звучит круто... пока не понимаешь, насколько это дорого.

Нужны огромные данные, вычисления и время.

И здесь появляется transfer learning.

Вместо старта с нуля вы берете уже обученную модель и адаптируете ее.

Это как переиспользование навыков.

Если вы умеете ездить на велосипеде, освоить мотоцикл проще.

Так же работает и здесь.

Именно поэтому сегодня можно создавать мощные решения без миллиардов данных.

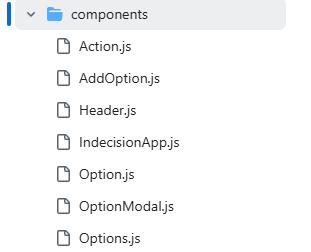

Transformer Stack

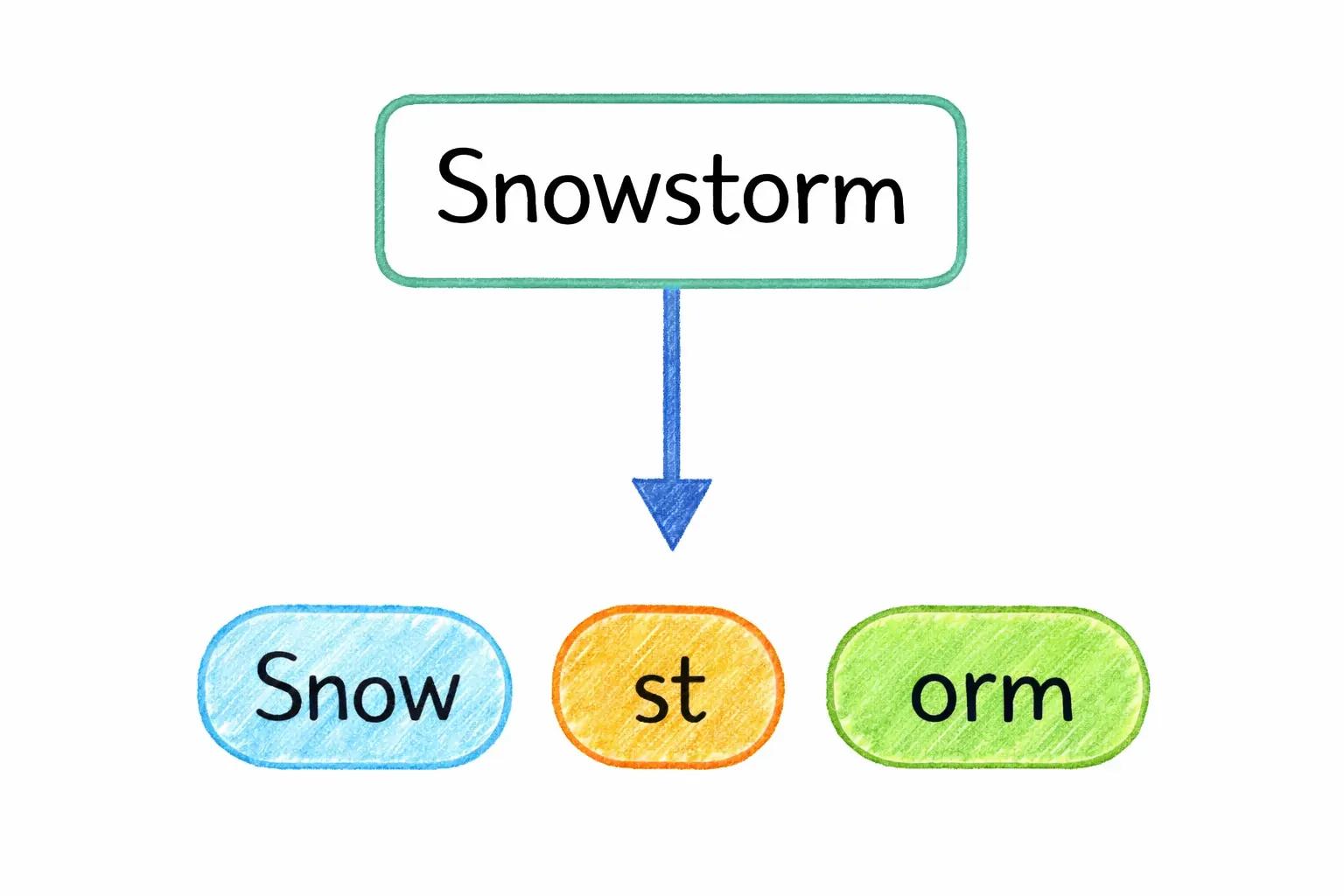

3. Токенизация

Прежде чем модель поймет текст, она разбивает его на части - токены.

Это не всегда слова.

Иногда это части слов.

Почему не использовать слова?

Потому что язык слишком сложный и изменчивый.

Токенизация решает эту проблему.

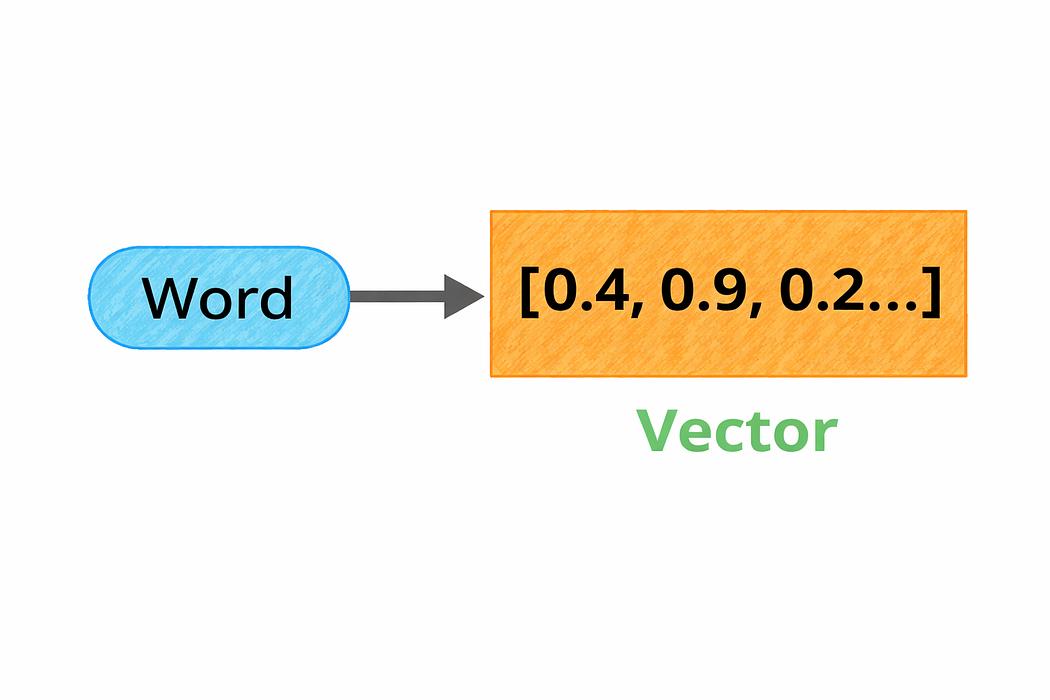

4. Эмбеддинги

После токенизации текст превращается в числа.

Каждый токен становится вектором.

Смысл определяется расстоянием между ними.

Похожие слова находятся рядом.

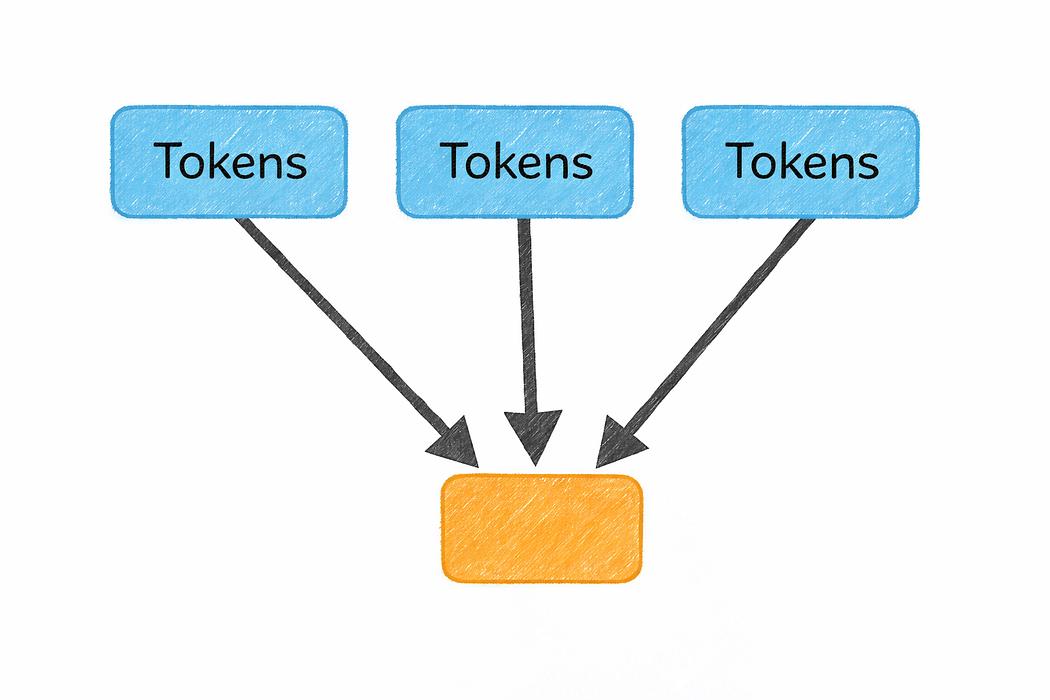

5. Attention

Смысл слова зависит от контекста.

Attention позволяет модели "смотреть" на все слова сразу и выбирать важные.

Это ключевая идея современного ИИ.

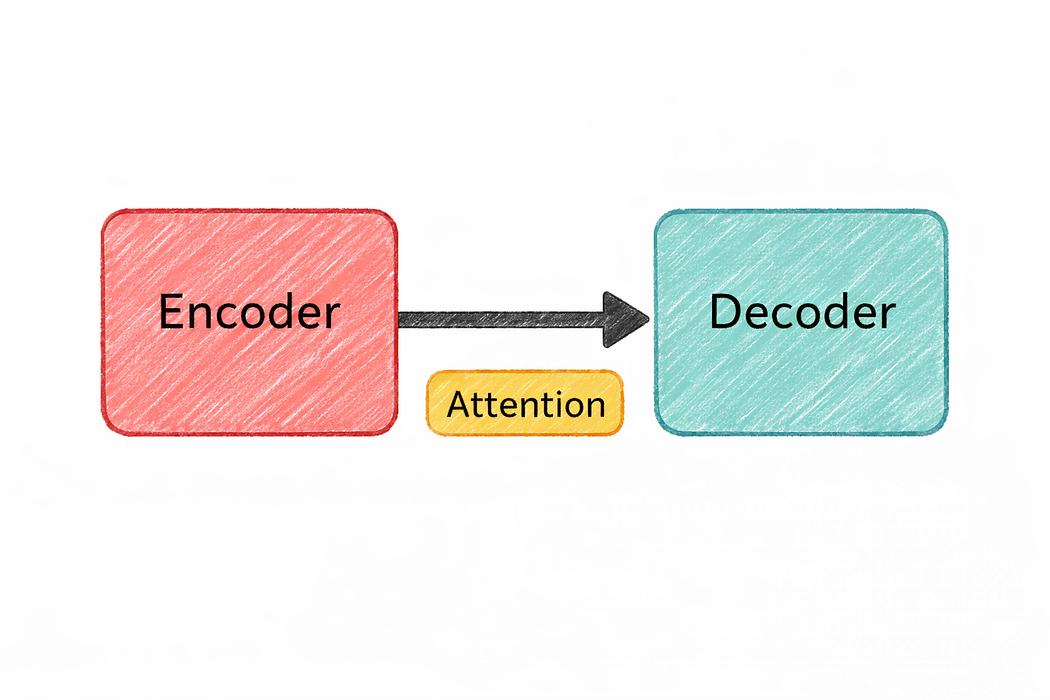

6. Transformer

Все компоненты объединяются в архитектуре transformer.

Она позволяет обрабатывать текст параллельно, а не последовательно.

Именно поэтому современные модели такие быстрые и мощные.

Большие языковые модели

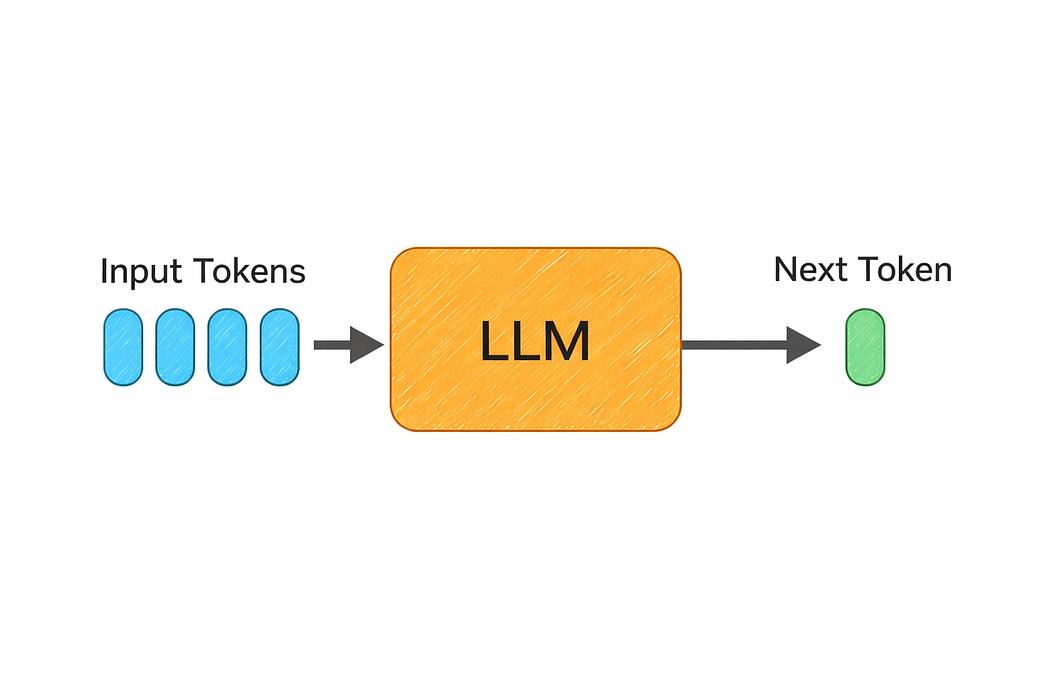

7. LLM

LLM - это transformer, обученный на огромном количестве текста.

Задача проста: предсказать следующий токен.

Но в масштабе это дает невероятные возможности.

Если хотите глубже разобраться в том, как устроены такие системы на практике, можно изучить курс по нейросетям и машинному обучению, где базовые концепции разбираются последовательно.

8. Контекстное окно

Это объем текста, который модель может учитывать одновременно.

Чем он больше - тем лучше понимание.

9. Temperature

Контролирует "креативность" модели.

Низкое значение - точность.

Высокое - разнообразие.

10. Галлюцинации

Модель может уверенно ошибаться.

Она генерирует вероятный текст, а не проверяет факты.

Обучение и оптимизация

11. Fine-Tuning

Донастройка модели под конкретную задачу.

12. RLHF

Обучение с учетом человеческой обратной связи.

Делает ответы полезными и безопасными.

13. LoRA

Легкая альтернатива fine-tuning.

Добавляются небольшие обучаемые блоки.

14. Quantization

Сжатие модели для экономии ресурсов.

Промпты и мышление

15. Prompt Engineering

Качество результата зависит от формулировки запроса.

16. Chain of Thought

Модель решает задачу пошагово.

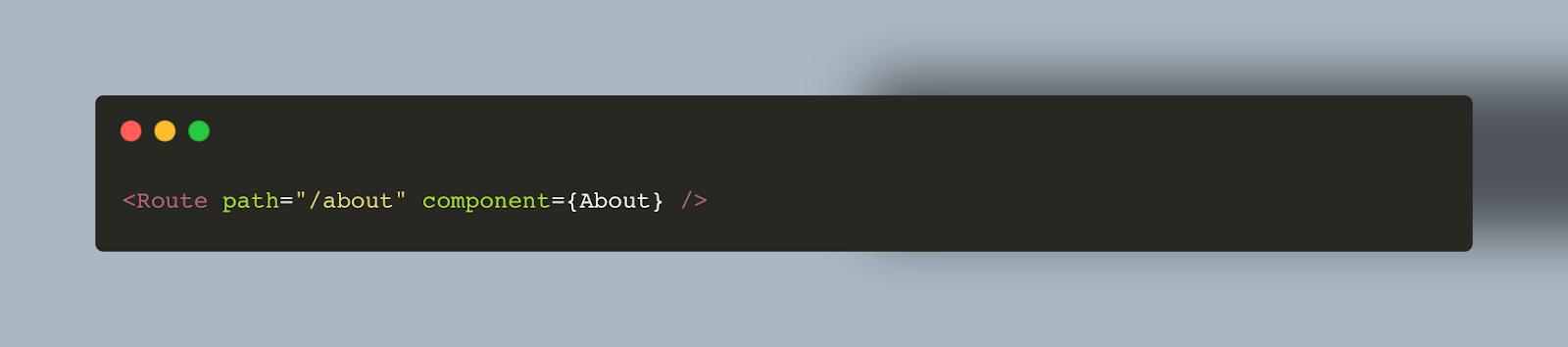

Построение систем

17. RAG

Модель использует внешние данные для ответа.

18. Векторные базы данных

Поиск по смыслу, а не по словам.

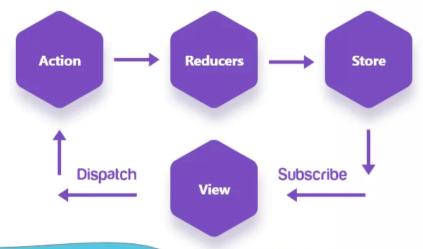

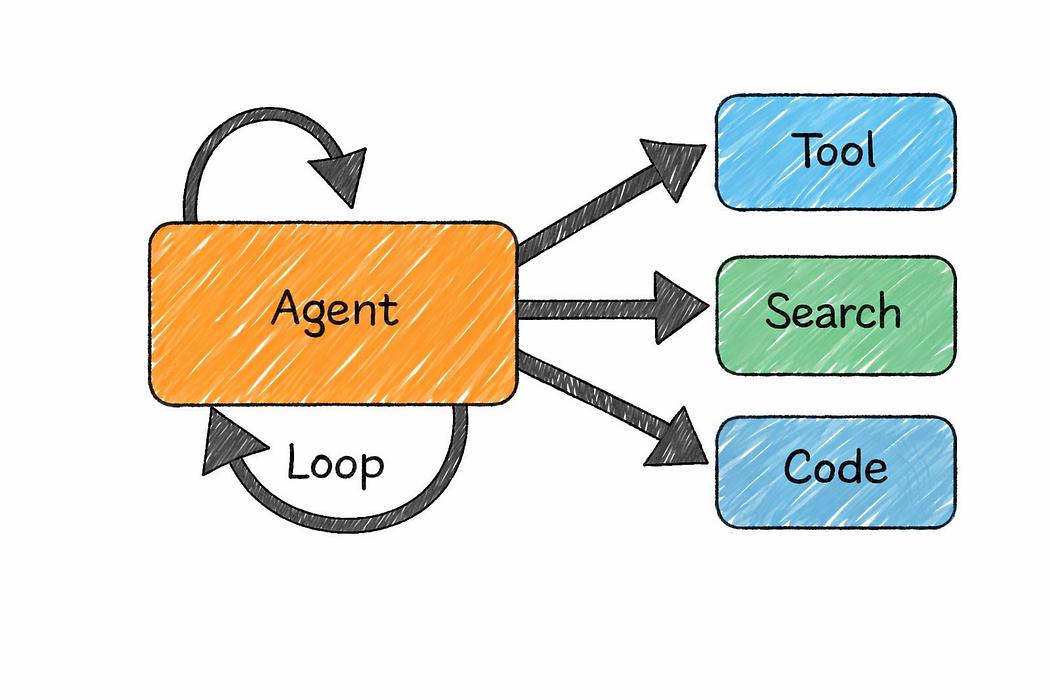

19. AI-агенты

Модели, которые могут выполнять действия.

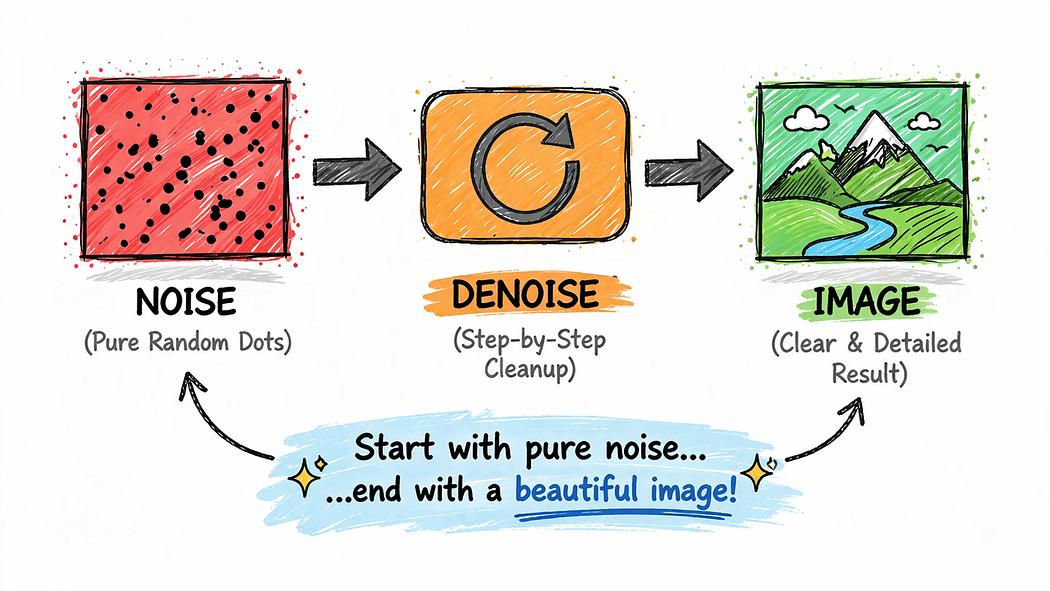

20. Диффузионные модели

Генерация изображений через удаление шума.

Рады, что вы дочитали до конца.

.

Получите бесплатные уроки на наших курсах

- Нейросети с нуля

- Redis для разработчиков и DevOps

- Системный аналитик с нуля

- Data Science с нуля

- MongoDB для разработчиков и DevOps